- 快召唤伙伴们来围观吧

- 微博 QQ QQ空间 贴吧

- 文档嵌入链接

- 复制

- 微信扫一扫分享

- 已成功复制到剪贴板

深度学习解释性:从“能”到“不能”

展开查看详情

1 . ) TC BD ( 深度学习解释性: 会 大 从“能”到“不能” 术 技 据 数 大 桑基韬 国 中 北京交通大学 计算机科学系 18 20

2 .深度学习应用研究:视觉+语言 ) TC BD 米歇尔奥巴马 故宫 彭丽媛 实体标注 ( 会 大 特征提取 物体检测 语义标注 多媒体 术 问答 技 据 数 大 多媒体 国 叙事 中 描述生成 语言 18 20 jtsang@bjtu.edu.cn 2 2

3 .深度学习理论研究: 从“能”到“不能” ) TC BD 米歇尔奥巴马 故宫 彭丽媛 实体标注 ( 会 大 特征提取 物体检测 语义标注 多媒体 术 问答 技 据 数 大 多媒体 国 叙事 中 描述生成 18 随着深度学习的应用拓展,从探索深度学习“能” 20 做什么,发展到思考深度学习“不能”做什么。 3 jtsang@bjtu.edu.cn 3

4 .深度学习的“不能”(1) ) TC 算法输出不稳定,容易被“攻击” BD 对抗样本 ( 会 大 术 “African elephant” “koala” difference 10x difference 技 据 数 大 国 one pixel attack 中 18 20 jtsang@bjtu.edu.cn 4 4

5 .深度学习的“不能”(1) ) TC 算法输出不稳定,容易被“攻击” BD ( 75% 会 36% 大 7% 术 技 据 数 大 国 中 18 20 jtsang@bjtu.edu.cn 5 5

6 .深度学习的“不能”(2) ) TC 模型复杂度高,难以纠错和调试 BD ( 会 大 术 技 实际的我们 据 数 大 国 中 18 20 jtsang@bjtu.edu.cn 6 6

7 .深度学习的“不能”(2) ) TC 模型复杂度高,难以纠错和调试 BD ( “世界末日时钟还差3分钟到12 会 点。我们正在经历世界上的人物 和戏剧性的发展,这表明我们越 大 来越接近末日和耶稣的回归。” 术 技 据 数 大 Deep Dream 国 中 恶作剧? 18 20 《Bible》 jtsang@bjtu.edu.cn 7 7

8 .深度学习的“不能”(3) ) TC 模型层级复合程度高,参数不透明 BD ( 会 大 术 技 据 数 大 国 中 18 20 jtsang@bjtu.edu.cn 8 8

9 .深度学习的“不能”(3) ) TC 模型层级复合程度高,参数不透明 BD 第一层:16*3*3*3 第二层:N*16*3*3 ( 会 大 术 技 感受野复合 据 卷积核复合 数 大 国 中 18 inception 残差 门结构 20 jtsang@bjtu.edu.cn 9 9

10 .深度学习的“不能”(4) ) TC 端到端训练方式对数据依赖性强,模型增量性差 BD ( 泛化误差 训练误差 会 m = #训练样本 大 N = effective capacity (模型有效容量) 术 上界 当样本数据量小的时候,深度学习 技 #参数 / VC维 / Rademacher复杂度 无法体现强大拟合能力 据 数 游艇 大 ? 马 人 飞盘 一群人 国 草地 草地 语义标注 中 农舍 ? 18 跑步 山 图像描述 20 投掷 摔跤 关系检测 jtsang@bjtu.edu.cn10 10

11 .深度学习的“不能”(5) ) TC 专注直观感知类问题,对开放性推理问题无能为力 BD ( 会 大 术 技 据 数 大 国 中 18 20 jtsang@bjtu.edu.cn11 11

12 .深度学习的“不能”(5) ) TC 专注直观感知类问题,对开放性推理问题无能为力 BD ( 会 大 术 “鹦鹉”智能 “乌鸦”智能 技 据 数 大 国 中 18 20 jtsang@bjtu.edu.cn12 12

13 .深度学习的“不能”(5) ) TC 专注直观感知类问题,对开放性推理问题无能为力 BD ( 会 一群大象 大 民主党 术 技 据 奥巴马 男人 数 大 大象 国 中 民主党 18 20 jtsang@bjtu.edu.cn13 13

14 .深度学习的“不能”(6) ) TC 人类知识无法有效引入进行监督,机器偏见难以避免 BD ( 会 大 术 技 据 数 大 国 中 18 20 jtsang@bjtu.edu.cn14 14

15 .深度学习的“不能”(6) ) TC 人类知识无法有效引入进行监督,机器偏见难以避免 BD ( 会 Nurse 大 Homemaker 术 技 据 数 大 国 中 18 20 jtsang@bjtu.edu.cn15 15

16 .深度学习的“不能”(6) ) TC 人类知识无法有效引入进行监督,机器偏见难以避免 BD 微软开发了Tay聊天机器人,模仿年轻网民的语言模式。 试用24小时后,被引入歧途,成为偏激的种族主义者,甚至发出了 ( “希特勒无罪”的消息。 会 大 术 技 据 数 大 美国法院用以评估犯罪风险的算法 COMPAS,被证明对黑人造成了系 国 统性歧视。 中 18 20 算法依赖于大数据,但数据不是中立的:从真实社会中抽 取,必然带有社会固有的不平等、排斥性和歧视。 16 jtsang@bjtu.edu.cn 16

17 .深度学习的“不能”(6) ) TC 人类知识无法有效引入进行监督,机器偏见难以避免 BD 阿西莫夫机器人三定律 ( 机器人不得伤害人类,或 会 坐视人类受到伤害; 大 除非违背第一法则,否则 术 机器人必须服从人类命 技 令; 除非违背第一或第二法 则,否则机器人必须保护 据 数 自己 大 国 中 18 20 jtsang@bjtu.edu.cn17 17

18 .深度学习的“不能”与解释性 ) TC 深度学习的“不能” BD ( 稳定性低 会 大 可调试性差 术 参数不透明 技 机器偏见 据 数 大 增量性差 国 中 推理能力差 18 20 jtsang@bjtu.edu.cn18 18

19 .深度学习的“不能”与解释性 ) TC 深度学习的“不能” 解释性的三个层次 BD ( 稳定性低 找 “对症下药” 会 得 知道哪些特征对输出有重要影 到 大 响,出了问题准确快速纠错 可调试性差 术 参数不透明 看 技 不再“对牛弹琴” 得 机器偏见 据 懂 双向:算法能被人的知识体系 理解 +利用和结合人类知识 数 大 增量性差 留 “站在巨人的肩膀上” 国 得 知识得到有效存储、积累和复用 下 中 推理能力差 越学越聪明 18 20 jtsang@bjtu.edu.cn19 19

20 .政府关注 ) TC BD 美国 欧盟 ( 中国 会 2017年4月,美国国防部先进 研究项目局DARPA资助了可解 2017年7月,国务院在 大 释性人工智能项目Explainable 术 《新一代人工智能发展规划》 AI, 提高AI决策的解释能力。 中提出“实现具备高可解释 技 性、强泛化能力的人工智能” 据 数 《一般数据保护条例》规定: 大 线性回归 自2018 年5 月25 日起要求所 国 解 决策树 有算法解释其输出原理,保证 中 释 SVM 数据隐私和算法公平性 性 18 随机森林 深度学习 20 准确性 jtsang@bjtu.edu.cn20 20

21 .工业界关注 ) TC 欧盟《一般数据保护条例》: 微软投入1600多名工程师,为全球客户提供 BD 符合GDPR的算法服务; ( Facebook将美国、加拿大和欧盟国之外的约 会 15亿用户的注册地从柏林移至美国。 大 术 谷歌神经网络可视化开源平台 机器偏见/深度学习安全 技 Lucid: 同时展现单个神经元与输入-输出的关联; Ian GoodFellow在 Jeff Dean力推支持 据 OpenAI和谷歌大脑专 数 注深度学习安全研 大 究; 国 中 18 20 jtsang@bjtu.edu.cn21 21

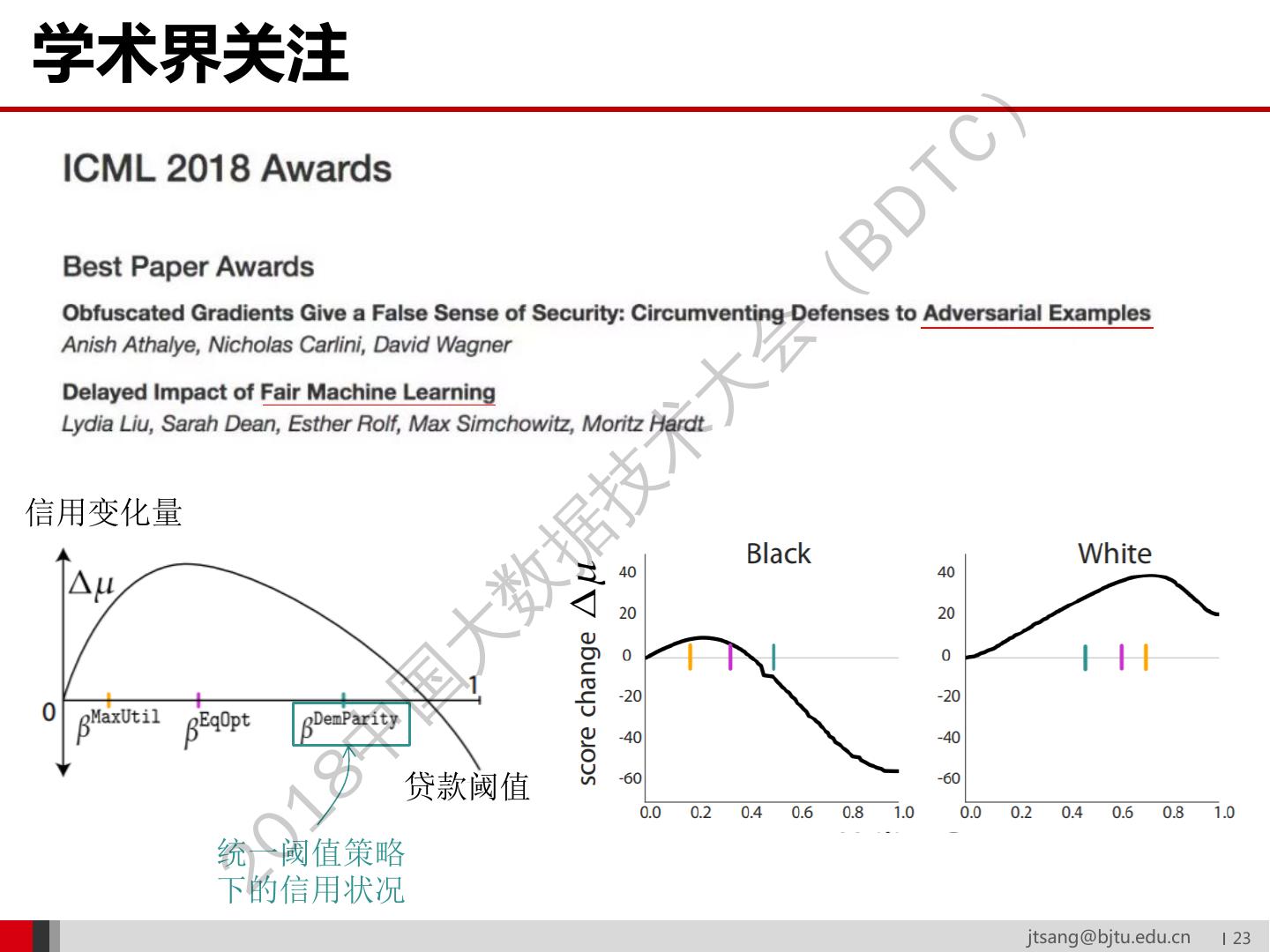

22 .学术界关注 ) TC BD ( 会 大 术 技 据 数 大 国 中 18 成功攻击了ICLR2018 20 八篇防御文章中的七篇 jtsang@bjtu.edu.cn22 22

23 .学术界关注 ) TC BD ( 会 大 术 技 信用变化量 据 数 大 国 中 贷款阈值 18 20 统一阈值策略 下的信用状况 jtsang@bjtu.edu.cn23 23

24 .机器学习解释性:定义 ) TC 机器学习:从数据中自动提取知识 BD 最常用定义 ( “计算机系统能够利用经验 会 提高自身的性能” 大 术 可操作定义 技 “机器学习本质是一个基于 据 经验数据的函数估计问题” 数 大 统计学定义 国 “提取重要模式、趋势,并 中 理解数据,即从数据中学 18 习” 20 jtsang@bjtu.edu.cn24 24

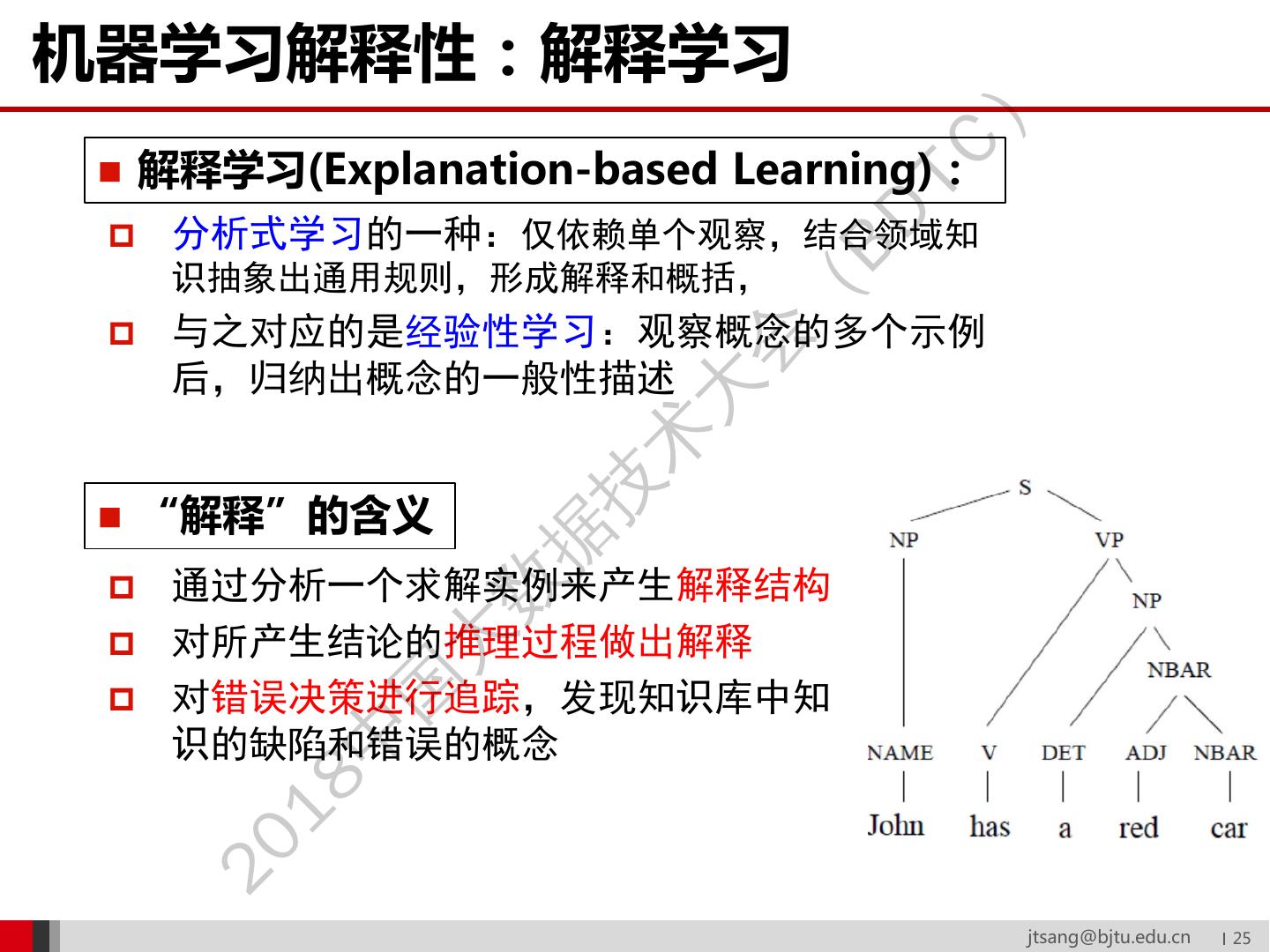

25 .机器学习解释性:解释学习 ) TC 解释学习(Explanation-based Learning): BD 分析式学习的一种:仅依赖单个观察,结合领域知 识抽象出通用规则,形成解释和概括, ( 与之对应的是经验性学习:观察概念的多个示例 会 后,归纳出概念的一般性描述 大 术 技 “解释”的含义 据 通过分析一个求解实例来产生解释结构 数 对所产生结论的推理过程做出解释 大 国 对错误决策进行追踪,发现知识库中知 识的缺陷和错误的概念 中 18 20 jtsang@bjtu.edu.cn25 25

26 .机器学习解释性:根据解释的阶段分类 ) (ICML 2017 TC 建模前解释 tutorial) BD 数据可视化:建立对数据的直观理解(数据量大或数据 ( 维度非常高时) 会 探索性数据分析:分析发现具有代表性的数据模式 大 术 技 据 数 大 国 中 使用MMD-critic从ImageNet数据集中学到的 18 代表性样本和非代表性样本 20 jtsang@bjtu.edu.cn26 26

27 .机器学习解释性:根据解释的阶段分类 ) (ICML 2017 TC 建立可解释模型 tutorial) BD 基于规则的方法:模型决策可 ( 通过逻辑规则表示,如决策树 会 大 术 基于特征权重的方法:特征权 技 重代表特征对于决策的重要程 度,如广义线性模型 据 数 大 国 基于实例的方法:通过代表性 中 的样本来解释聚类/分类结果, 18 如K近邻 20 jtsang@bjtu.edu.cn27 27

28 .机器学习解释性:根据解释的阶段分类 ) (ICML 2017 TC 建模后解释:用可解释方法理解模型 tutorial) BD 输入/特征敏感性分析:通过输 ( 入或特征的变化对结果的影响 会 来判断输入/特征的重要性 大 术 特征可视化:通过发现特征激 技 活与输入模式/概念的关联建立 据 特征的概念表示 数 大 国 转化为可解释模型:用稀疏线 中 性模型、决策树等可解释模型 18 来近似神经网络 20 jtsang@bjtu.edu.cn28 28

29 .机器学习解释性:根据解释的对象分类 ) (GCPR 2018 TC 解释数据 tutorial) BD 数据可视化 + 探索性数据分析 ( 会 大 解释决策 术 个体:理解具体决策,如为什么 技 特定输入可以导致这样的输出 据 数 解释模型 大 国 全局:理解模型本身,如什么样 中 的典型输入模式可以导致输出 18 20 jtsang@bjtu.edu.cn29 29