- 快召唤伙伴们来围观吧

- 微博 QQ QQ空间 贴吧

- 文档嵌入链接

- 复制

- 微信扫一扫分享

- 已成功复制到剪贴板

深度学习结构和算法比较分析

展开查看详情

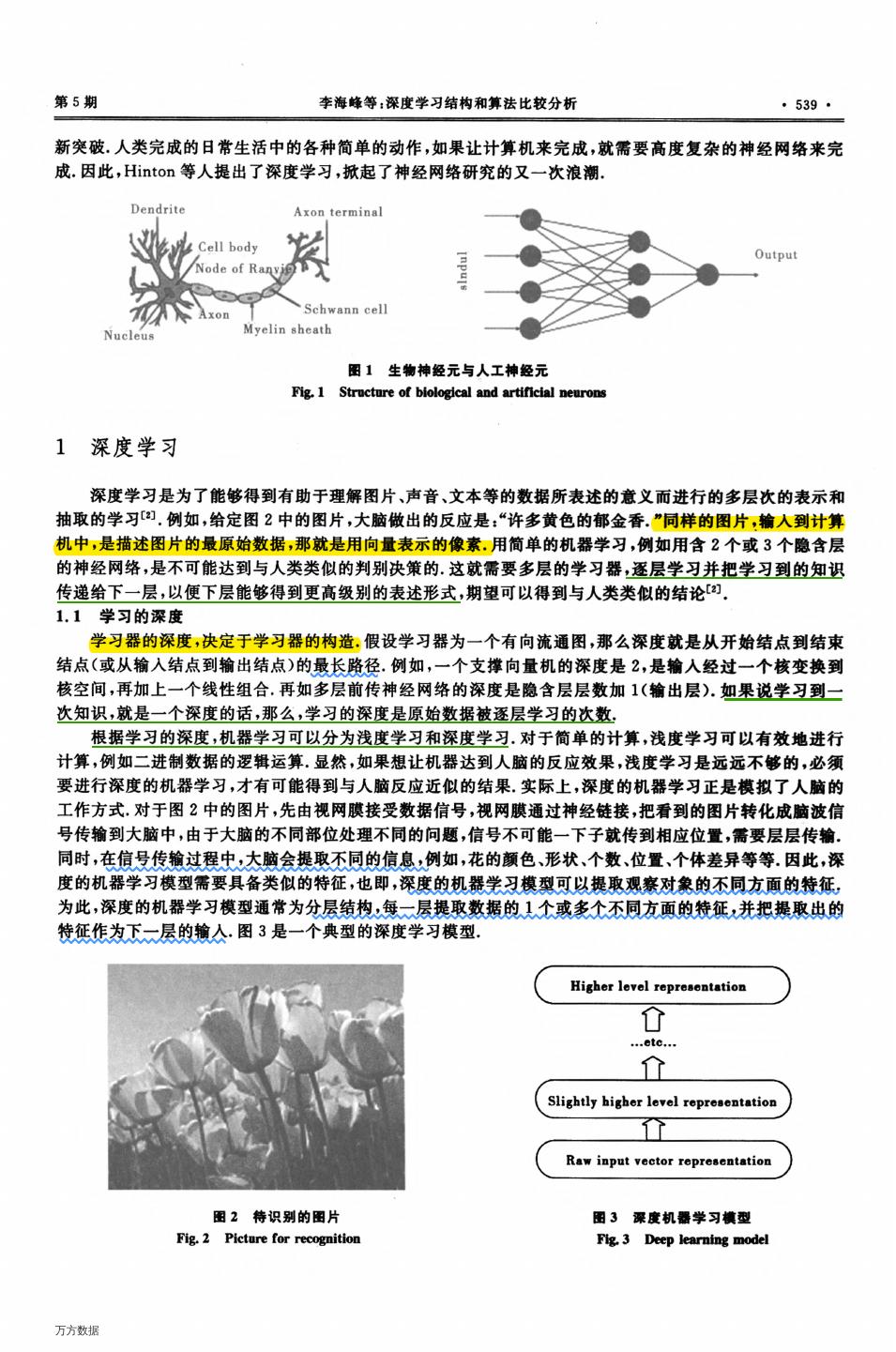

1 . 2012拄 河北大学学报(自然科学版 ) 2012 第32卷第5期 Journal of Hebei University(Natural Science Edition) V01.32 No.5 深度学习结构和算法比较分析 李海峰1,李纯果2 (1.河北大学教务处,河北保定071002;2.河北大学数学与计算机学院,河北保定071002) 摘 要:Hinton等人提出的深度机器学习,掀起了神经网络研究的又一个浪潮.介绍了深度机器学习的 基本概念和基本思想.对于目前比较成熟的深度机器学习结构深度置信网DBNs和约束Boltzmann机 (RBM)的结构和无监督贪婪学习算法作了比较详细的介绍和比较,并对算法的改进方向提出了有建设性的 意见,对深度机器学习的未来发展方向和目前存在的问题进行了深刻的分析. 关键词:深度机器学习;无监督贪婪学习算法;DBNs;RBMs 中图分类号:TP391 文献标志码:A 文章编号:1000—1565(2012)05—0538一07 Note on deep architecture and deep learning algorithms LI Haifen91,LI Chungu02 (1.Department of Academic Affairs,Hebei University,Baoding 071002,China; 2。College of Mathematics and Computer Science,Hebei University,Baoding 07 1002,China) Abstract:Deep architectures proposed by Hinton et al stir up another study wave in neural networks. This paper introduced the idea and basic concepts in deep learning.DBNs and RBMs are the advanced structures of deep learning,whose structures and effective learning algorithm are also introduced in detail in this paper.In addition,open questions in deep learning are also briefly displayed SO that researchers who are interested in can devote themselves into those questions and solve them. Key words:deep learning;greedy learning algorithm;DBNs;RBMs 随着电脑的普及与发展,智能化、机械化成为人们关注的热点.机器学习是仿照人类大脑工作的方式,让 电脑进行计算,学习到类似于大脑的工作方式.为此,研究学者需要构建计算机能够运作的模型,例如,神经 网络就是根据人类的大脑神经的激活或抑制的信号传输构建的模型[1].神经网络的基本组成单位就是神经 元,神经元的构造方式完全模拟了人类大脑细胞的结构,如图1.但是,显而易见,人工神经元只是简单的结 构的模拟,要想达到与生物神经元有相同的功能,还远远的不够.科研工作者就其训练的方式对其进行训练。 试图让人工神经网络的运算功能尽可能的与人类接近.简单的网络已经可以进行基本的运算,甚至有2个隐 含层的非线性神经网络已经能够对任意的函数进行平滑的逼近.从1943年McCulloch和Pitts提出的简单 神经元开始,神经网络经历了几度兴衰.神经网络已经深入到各个领域,技术相对比较成熟,然而也很难再有 收稿日期:2012—04—05 基金项目:保定市科学技术研究与发展指导计划项目(12ZG005);河北省高等学校科学研究计划项目(JYGH20110t1) 第一作者:李海峰(1980一),男,河北唐县人,河北大学讲师,主要从事机器学习、教学信息化等研究. E-mail:lihf@hbu.edu.crl 万方数据

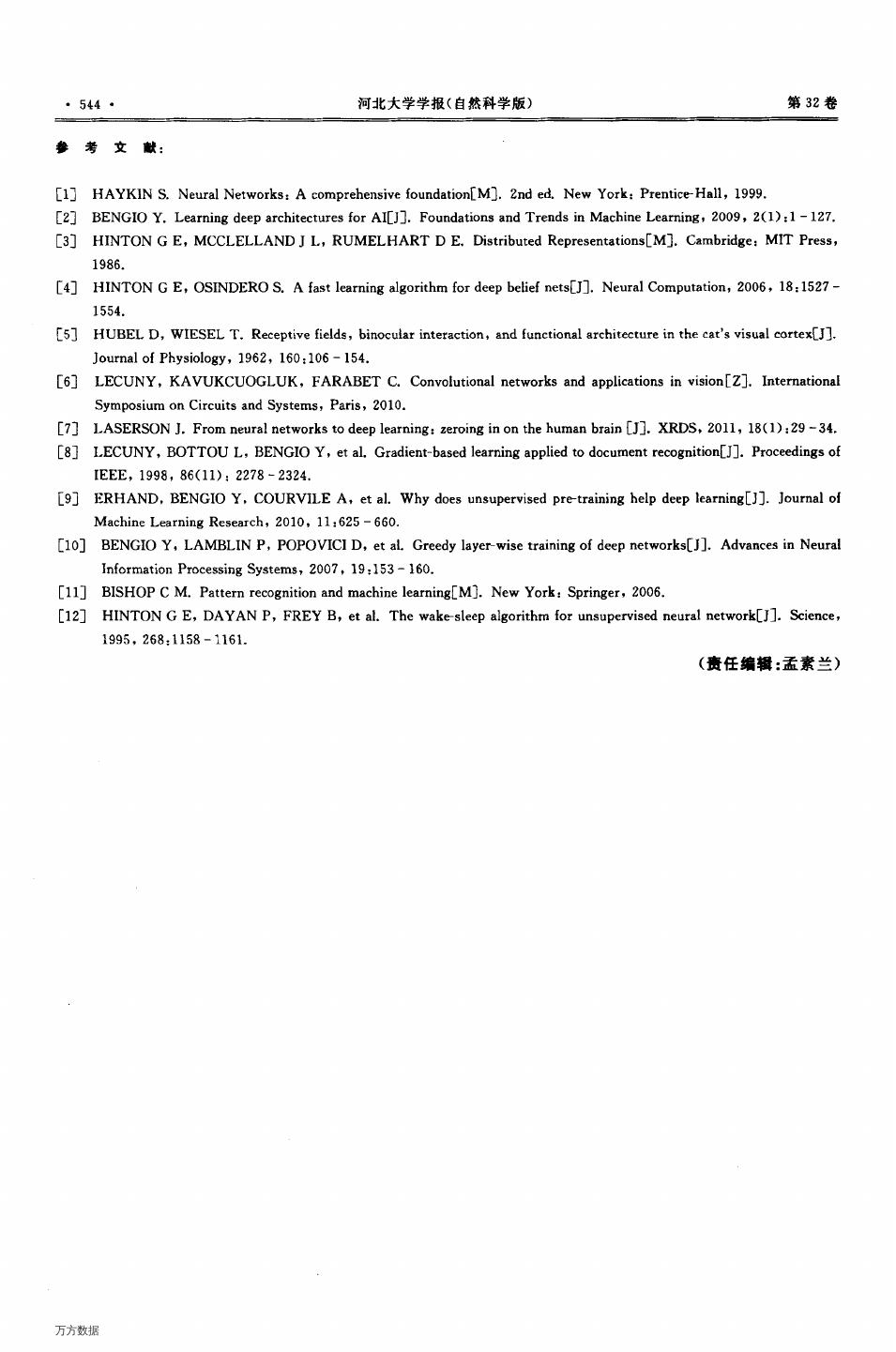

2 .第5期 李海峰等:深度学习结构和算法比较分析 新突破.人类完成的日常生活中的各种简单的动作,如果让计算机来完成,就需要高度复杂的神经网络来完 成.因此,Hinton等人提出了深度学习,掀起了神经网络研究的又一次浪潮. NUc 圈1生物神经元与人工神经元 №1 Structure of M¨ogI叫and"珊垴m琳—舢 1 深度学习 深度学习是为了能够得到有助于理解图片、声音、文本等的数据所表述的意义而进行的多层次的表示和 抽取的学习[2].例如,给定图2中的图片,大脑做出的反应是:“许多黄色的郁金香.”同样的图片.输入到计算 机中,是描述图片的最原始数据,那就是用向量表示的像素.用简单的机器学习,例如用含2个或3个隐含层 的神经网络,是不可能达到与人类类似的判别决策的.这就需要多层的学习器,逐层学习并把学习到的知识 传递给下一层,以便下层能够得到更高级别的表述形式,期望可以得到与人类类似的结论[2]. 1.1学习的深度 学习器的深度,决定于学习器的构造.假设学习器为一个有向流通图,那么深度就是从开始结点到结束 结点(或从输入结点到输出结点)的最长路径.例如,一个支撑向量机的深度是2,是输人经过一个核变换到 核空间,再加上一个线性组合.再如多层前传神经网络的深度是隐含层层数加1(输出层).如果说学习到一 次知识,就是一个深度的话,那么,学习的深度是原始数据被逐层学习的次数. 根据学习的深度,机器学习可以分为浅度学习和深度学习.对于简单的计算,浅度学习可以有效地进行 计算,例如二进制数据的逻辑运算.显然,如果想让机器达到人脑的反应效果,浅度学习是远远不够的,必须 要进行深度的机器学习,才有可能得到与人脑反应近似的结果.实际上,深度的机器学习正是模拟了人脑的 工作方式.对于图2中的图片,先由视网膜接受数据信号,视网膜通过神经链接,把看到的图片转化成脑波信 号传输到大脑中,由于大脑的不同部位处理不同的问题,信号不可能一下子就传到相应位置,需要层层传输. 同时,在信号传输过程中,大脑会提取不同的信息,饲如,花的颜色、形状、个数、位置、个体差异等等.因此,深 度的机器学习模型需要具备类似的特征,也即,深度的机器学习模型可以提取观察对象的不同方面的特征. 为此,深度的机器学习模型通常为分层结构,每一层提取数据的1个或多个不同方面的特征,并把提取出的 特征作为下一层的输入.图3是一个典型的深度学习模型. 口 …etc… 啊2待识嗣的圈片 圈3深度机■学习羹墨 Fig.2 Picture for recognition Fig.3 Deep k柚咖g model 万方数据

3 . 河北大学学报(自然科学版) 第32卷 1.2深度学习的动机 从早期的神经网络的学习,到现在的深度学习,究其机制,都是从模拟大脑的构架并辅以一定的学习算 法,从而使计算机的工作方式尽可能地接近人类的工作方式.机器学习从仅有2层左右的学习构架,要向有 多层的结构发展,不仅有生物神经元的启示,也是对现有的机器学习结构的弊端的改进. 首先,人类大脑的神经元系统是一个庞大的结构,由无数个神经元共同组成,完成一定的生理功能.例如, 从视网膜到处理视网膜的大脑区域,需要经过无数层的神经元层层传递视觉信息,最终到达大脑的视觉处理区 域,然后再经过信息处理,把信息反馈到肌肉神经,或语言区域.这个过程在生物神经元系统只不过是瞬间的事 情,但是,完成这个过程,是由已经训练好的神经系统完成的,神经系统对整个过程的处理,与从出生到成人的 认知过程是分不开的.而这一切,要用电脑来完成,不是构造简单的人工神经元就能够完成的,需要大规模的神 经元组织和链接,并经过来自于外界信息的不断强化和训练.故从结构上,神经网络结构要加深. 其次,如果神经网络的层次不够深,那么,多项式级的参数个数能解决的问题就有可能需要指数级的参 数个数.例如,要计算Ⅱ:一,己:‘-。口¨计算方式不同,计算复杂度会有很大的不同.如果计算和的积,计算复 杂度为0(ran);如果计算积的和,计算复杂度为0(卵”).参数多的结构不仅训练复杂,训练时间长,而且泛化 性能也很差,也容易产生过拟合问题. 再次,有很多学习结构的学习算法使得到的学习器是局部估计算子.例如,由核方法构造的学习器, 厂(z)一6+2/?;.口iK(z,z。),是由对模板的匹配度加权构成.对于这样的问题,往往要求被拟合函数都是平 滑的,如果不平滑,该学习器就不能很好地拟合数据.而在实际应用中的很多例子,往往不满足平滑这个条 件,或者对于被拟合函数一无所知.此时,模板匹配方法就不再可行. 最后,深度机器学习是数据分布式表示的必然结果口].分布式表示系统是由一组信息计算单元共同完成 的,每一个概念都由不止1个信息计算单元表示,而每一个信息计算单元也参与计算不止1个概念口].例如, ,1.f—i 表示整数i(i一1,2,…,N),有2种表示方式,~种用1个N维向量r(i)表示,r,(i)一J一。i,.,另一种表示 !o,J≠i 方式是用log。N维的向量表示,表示方式类似于二进制.显然,后一种表示方式更紧凑,这种表示方式就是 分布式表示.分布式表示不仅可以很好地描述概念间的相似性,而且合适的分布式表示在有限的数据下能体 现出更好的泛化性能.人类的认知活动包括理解昶处理接受到的信息,这些信息的结构通常很复杂,因此,有 必要构造深度结构的学习机器去实现一些人类的认知活动. 由于其自身的复杂性,深度学习算法很多年都没有新的进展.就监督的多层神经网络来说,无论是测试 精度还是训练精度,深度学习的结果远远不如有1个或2个隐含层的神经网络的结果.直到2006年,Hinton 等人提出了贪婪无监督逐层学习算法H],深度学习的问题才有所突破. 2 深度学习的方法 同机器学习方法一样,深度机器学习方法也有监督学习与无监督学习之分.不同的学习框架下建立的学习 模型很是不同.例如,卷积神经网络(Convolutional neural networks,简称CNNs)就是一种深度的监督学习下的 机器学习模型,而深度置信网(Deep Belief Nets,简称DBNs)就是一种无监督学习下的机器学习模型. 2.1卷积神经网络 20世纪60年代,Hubel和Wiesel在研究猫脑皮层时,发现了一种独特的神经网络结构,可以有效地降 低反馈神经网络的复杂性,进而提出了卷积神经网络口].现在,卷积神经网络已经发展成一种高效的图像识 别方法‘6|. 卷积神经网络的基本结构如图4所示.卷积神经网络是一种非全连接的神经网络结构,包含2种特殊的 结构层:卷积层和次抽样层.卷积层由多个特征平面构成,完成抽取特征的任务.每个特征平面由神经元构 成,在同一个特征平面上的所有神经元具有相同的连接权重.对于每个神经元,定义了相应的接受域口剖,只 万方数据

4 .第5期 李海峰等t深度学习结构和算法比较分析 接受从其接受域传输的信号,如图5.同一个特征平面的神经元的接受域具有相同的大小,故而每个神经元 的连接矩阵相同.根据卷积的数学定义,(厂*g)(z)=J f(u)g(x--u)du,或(,*g)(以)=2S。f(m)g(n一 仇),网络的卷积层应用了卷积的离散表示.设所考查层的第五个特征平面记作h‘,与前一层的连接权重矩阵 为W‘,偏差为b‘,对于非线性的正切函数,可以得到特征映射如下: ^:=tanh((W。*z)Ⅱ+6I), (1) 其中,i和.『标注了该神经元在特征平面上的位詈. INPUT feature maps feature maps feature maps feature maps OUTPUT 28X28 4@24×24 4@12X 12 12@8×8 12@4×4 26@1x 1 图4用于图像识别的卷积神经网络结构 Fig.4 Convolution network for image recognition ・・,≮:::::0‘≯.....・ 7.、。 0一㈠” .,。“l、、、 .’f㈡’ ...j:j 7:一』00:Ij、... ’.。・.・..・.●・ ‘ ‘ ● ● 每个卷积层都会紧跟1个次抽样层.输入数据经过卷积后,进入高维空间,换句话说,卷积层进行了升维 映射.如果不断地进行升维,则不可避免地陷入维数灾难.同卷积层类似,次抽样层的每个特征平面上的神经 元也共享连接权重,且每个神经元都从其接受域中接受数据.卷积层的每个特征平面都对应了次抽样层的1 个特征平面,次抽样层中的神经元对其接受域中的数据进行抽样(例如,取大,取小,取平均值,等等),因此次 抽样层的特征平面上的神经元的个数往往会减半. 卷积层的每一个平面都抽取了前一层某一个方面的特征.每个卷积层上的每个结点,作为特征探测器, 共同抽取输入图像的某个特征,例如45。角、反色、拉伸、翻转、平移等.图像经过一层卷积,就由原始空间被 影射到特征空间,在特征空间中进行图像的重构.卷积层的输出,为图像在特征空间中重构的坐标,作为下一 层也就是次抽样层的输入. LeCun从1998年开始,专注于卷积神经网络的研究,提出了LeNet模型[81(如图6),用于识别手写和机 打字体,逐渐已经适用识别很多类图形问题.由图6所示,输入层后有2组隐含层抽取输入图像的特征,最后 有一个全连接的隐含层完成对输入图像的识别.LeNet模型在识别手写数字上达到很高的识别率,而且具有 拉伸、挤压、反转的不变性,而且抗噪能力很强.模型用传统的BP进行训练. 万方数据

5 . '}iirlP士学学拇r自帙烈学颤、 第32卷 ‰=.o 屯 兰 帆~ 协一 圈i耋} 6 6 =一 唑怒 ! 生竺 型 一 耋| 当 2.2深度置信网 深度置信网(Deep Belief Networks,简称DBNs)是另一种深度学习结构H],是多个RBM的累加.一个 Boltzmann机是基于能量理论的概率模型,通过热力学的能量函数定义了一个概率分布:Boltzmann分布. 设状态随机变量z,能量函数为E(z),则该状态出现的概率分布密度函数为夕(z)=e-£h’/z,其中Z= 25;e一胁’.一个典型的Boltzmann机是一个无向循环图,其能量函数定义为 E(x,^)=--b7z--f7h—z7Wh--X7Ux--h’Vh, (2) 其中z是可见变量,描述可以观察的数据;^是隐含变量,无法观察到其实际取值;b和h分别是可见变量和 隐含变量的阈值;W,U,V是结点之间的连接权重.如果对Boltzmann机加以约束条件,令其自身不与自身 连接,则得到一个有向无环图RBM(如图7a),其能量函数定义为E(z,I『1)一--b7z—f7|Il—z7ITCh. 一个典型的置信网可以看成是由多个随机变量组成的有向无环图,也可以看成是多个RBM的累加,而 深层置信网就是一个复杂度很高的有向无环图.Hinton等人(3]认为,一个有Z个隐含层的典型的DBN,可以 用联合概率分布刻画输入向量X和隐含向量h的关系 P(z,h2,…,h。)=(Ⅱ:I;P(胪I hH2))P(JIl卜2,h‘), (3) 其中z=ho,P(h‘lhH2)是条件概率分布.DBN学习的过程,就是学习联合概率分布的过程.而联合概率分 布的学习是机器学习中的产生式学习方式. 蓦 ]矗 ∞ooOo C| 删I rOooooOC| + l;1|f.-i酶 ● ● l 1 r rOOOOooQ 墨耄i ] } DCX:DOOC)Cj 聊 PretraininS b C a.RBM模型.b.DBN典型结构;C.用DBN进行图像识别示例. 圈7深度学习模型 Fig.7 Deep Learning M优lel 万方数据

6 .第5期 李海峰等:深度学习结构和算法比较分析 对于深度的机器学习,由于参数变量很多,所以合适的训练算法直接决定了学习器的性能.以往的基于 最速梯度下降的BP算法,在经典的神经网络中被广泛应用,可以得到泛化性能很好的网络结构,但是BP算 法对于深度学习器的训练却存在一定的困难.这主要是BP算法本身的约束所在.首先,BP算法是监督学 习,训练数据必须是有类标数据.但是,实际能得到的数据大都是无类标数据.其次,BP算法不适合有很多隐 含层的学习结构,一是计算偏导数很困难,二是误差需要层层逆传,收敛速度很慢.最后,BP算法经常会陷入 到局部最优解,不能到达全局最优解.因此,Hinton等人提出了贪婪的逐层无监督训练算法Ho. 贪婪无监督学习算法的基本思想是,把一个DBN网络分层,对每一层进行无监督学习,最后对整个网 络用监督学习进行微调.把一个DBN网络分层,每层都由若干计算单元(常常是几百个或几千个)组成(如 图7b),各自独立计算该层接受到的数据,每个层的节点之间没有连接.与外界环境连接的节点层为输入层, 输入层接受来自于外界的输入,例如图像数据.第1层(即输入层)与第2层构成一个典型的RBM,根据无监 督学习调节网络参数,使得RBM达到能量平衡.然后,第1层的输出作为第2层与第3层构成一个新的 RBM,第1层的输出作为外界输入,继续调节参数,使当前RBM结构达到能量平衡.如此进行下去,直到最 后一层(如图7c).当完成无监督逐层训练学习后,再以原始外界输入和目标输出对整个网络进行有监督学 习,以最大似然函数为目标,精调网络各层的参数。 Gibbs抽样技术是在训练每个RBM时采用的有效随机抽样技术[11].设需要从未知的联合概率分布厂 (zl,…,z^)中抽取咒个样本Xn’,Xo’,…,Xh’.由于 p(xml’....午・,研・9+i o,础5瓦再筹著焉‰∞pbl'.”一A 从而对某一个变量抽取样本时,假设其他变量已知,在以其他变量为条件的概率分布下进行抽取,直到抽取 ・,,….,、 出所有样本.换句话说,对于样本x“,的第j个变量,是从分布p(z≯I工P,…,z;翌。,z;舞",…,z:卜”)中抽取, 直到抽取出挖个样本. 在贪婪学习算法中,也采用了Wake-Sleep算法的基本思想m3.算法在觉醒阶段,采用学习到的权重,按照 自底朝上的顺序,为下一层产生训练需要用的数据。而在睡眠阶段,按照自顶朝下,用权重对数据进行重建,如 表1. 表1贪婪学习算法实现步骤 Tab.1 Implementing proeed岍of greedy layer-wise learning 步骤 内容 第1步 以z=h。为外界输人,训练第1个RBM,达到能量平衡; 第z步翼翥二亍学习到的输入的联合分布’作为第2层的RBM的输入’继 第3步重复第2步。直到最后一层; 第4步 以最大似然函数为目标函数,精调网络参数,使网络达到最优. 3 总结 神经网络是人工智能领域的一个重要分支,利用神经网络可以任意精度逼近任意光滑的曲线,这使得神 经网络成为人工智能、数据挖掘等领域的一个重要工具.本文主要是简要介绍了深度机器学习的主要思想, 以及有效的学习算法.深度机器学习是神经网络又一次兴起的标志.但是,深度机器学习的训练时间过长,常 常需要几个星期的训练时间,如果能合并训练,提高训练速度,则会大大提高深度机器学习的实用性.另外, 深度机器学习学习到的知识表示的物理意义很不明确,如果能把各层学习到的知识表示成有物理意义的知 识,则会增加学习到知识的可理解性.这些问题都有待解决. 万方数据

7 . .544. 河北大学学报(自然科学版) 第32卷 参考文献: [13 HAYKIN S.Neural Networks:A comprehensive foundation[M].2nd ed.New York:Prentice-Hall,1999. [2] BENGIO Y.Learning deep architectures for AID].Foundations and Trends in Machine Learning,2009,2(1):1—127. [3] HINTON G E,MCCLELLAND J L,RUMELHART D E,Distributed Representations[M].Cambridge:MIT Press, 1986. [4] HINTON G E.OSINDERO S.A fast learning algorithm for deep belief nets[J].Neural Computation,2006,18:1527一 1554. [5] HUBEL D,WIESEL T.Reeeptive fields,hinoeular interaction。and functional architecture in the eat’s visual eortex[J]. Journal of Physiology,1962,160:106—154. [6] LECUNY,KAVUKCUOGLUK,FARABET C.Convolutional networks and applications in vision[Z].International Symposium on Circuits and Systems,Paris,2010。 [7] LASERSON J.From neural networks tO deep learning:zeroing in on the human brain[J].XRDS,2011,18(1):29—34. [8] LECUNY。BOTTOU L,BENGIO Y,et a1.Gradient—based learning applied tO document recognition[J].Proceedings of lEEE,1998,86(11):2278—2324. [9] ERHAND。BENGIO Y,COURVILE A,et a1.Why does unsupervised pre-training help deep learning[J].Journal of Machine Learning Reseatch,2010,11:625—660. [103 BENGIO Y,LAMBLIN P,POPOVICI D,et a1.Greedy layer-wise training of deep networks[J].Advances in Neural lnformation Processing Systems,2007,19:153—160. [11] BISHOP C M.Pattern recognition and machine learning[M].New York:Springer,2006. [12] HINTON G E,DAYAN P,FREY B,et a1.The wake-sleep algorithm for unsupervised neural network[J].Science, 1995,268:1158—1161. (责任编辑:孟素兰) 万方数据

8 .深度学习结构和算法比较分析 作者: 李海峰, 李纯果, LI Haifeng, LI Chunguo 作者单位: 李海峰,LI Haifeng(河北大学教务处,河北保定,071002), 李纯果,LI Chunguo(河北大学数学与计算机学院,河北保定,071002) 刊名: 河北大学学报(自然科学版) 英文刊名: Journal of Hebei University(Natural Science Edition) 年,卷(期): 2012,32(5) 参考文献(12条) 1.HAYKIN S Neural Networks:A comprehensive foundation 1999 2.BENGIO Y Learning deep architectures for AI 2009(01) 3.HINTON G E;MCCLELLAND J L;RUMELHART D E Distributed Representations 1986 4.HINTON G E;OSINDERO S A fast learning algorithm for deep belief nets 2006 5.HUBEL D;WIESEL T Receptive fields,binocular interaction,and functional architecture in the cat's visual cortex 1962 6.LECUNY;KAVUKCUOGLUK;FARABET C Convolutional networks and applications in vision 2010 7.LASERSON J From neural networks to deep learning:zeroing in on the human brain 2011(01) 8.LECUNY;BOTTOU L;BENGIO Y Gradient-based learning applied to document recognition[外文期刊] 1998(11) 9.ERHAND;BENGIO Y;COURVILE A Why does unsupervised pre-training help deep learning 2010 10.BENGIO Y;LAMBLIN P;POPOVICI D Greedy layer-wise training of deep networks 2007 11.BISHOP C M Pattern recognition and machine learning 2006 12.HINTON G E;DAYAN P;FREY B The wake-sleep algorithm for unsupervised neural network 1995 本文链接:http://d.g.wanfangdata.com.cn/Periodical_hebdxxb201205016.aspx