- 快召唤伙伴们来围观吧

- 微博 QQ QQ空间 贴吧

- 文档嵌入链接

- 复制

- 微信扫一扫分享

- 已成功复制到剪贴板

递归神经网络

展开查看详情

1 .图片描述与 LSTM 报告人:唐圳 2016.12.31

2 .目录 CONTENTS 01 课题 背景 SUMMERY 02 递归神经网络 RNN 03 LSTM Long Short-Term Memory 04 眼下 NOW

3 .01 课题背景 SUMMERY

4 .课题背景 SUMMERY 01 第一,相比于文字,图片能够为用户提供更加 生动、容易理解、有趣 的信息; 第二,从图片来源来看,智能手机为我们带来 方便的拍摄和截屏 手段。 现代信息主流载体

5 .课题背景 SUMMERY 01 我们却无法通过 关键字 对图片中的内容进行 检索 ,从而影响了我们从图片中找到关键内容的 效率 。 在这个环境下,计算机的 图像识别 和 图像描述 技术就显得尤为重要。 现代信息主流载体

6 .课题背景 SUMMERY 01 如何让机器像人一样可以辨识图片并加上对应的 标签 ?

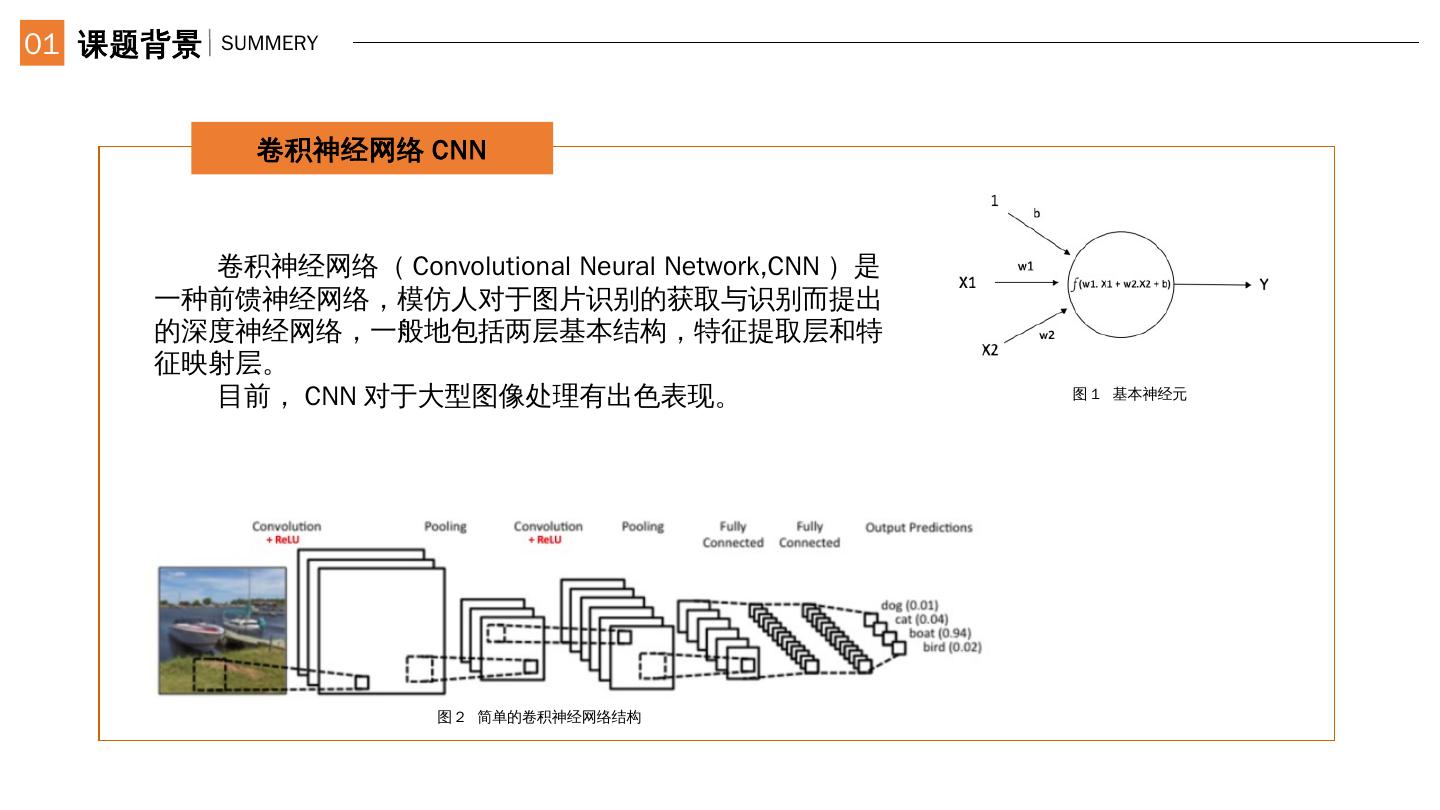

7 .课题背景 SUMMERY 01 卷积神经网络 CNN 卷积神经网络(Convolutional Neural Network,CNN)是一种前馈神经网络,模仿人对于图片识别的获取与识别而提出的深度神经网络,一般地包括两层 基本结构 ,特征提取层和特征映射层。 目前, CNN 对于大型图像处理有出色表现。 图 1 基本神经元 图 2 简单的卷积神经网络结构

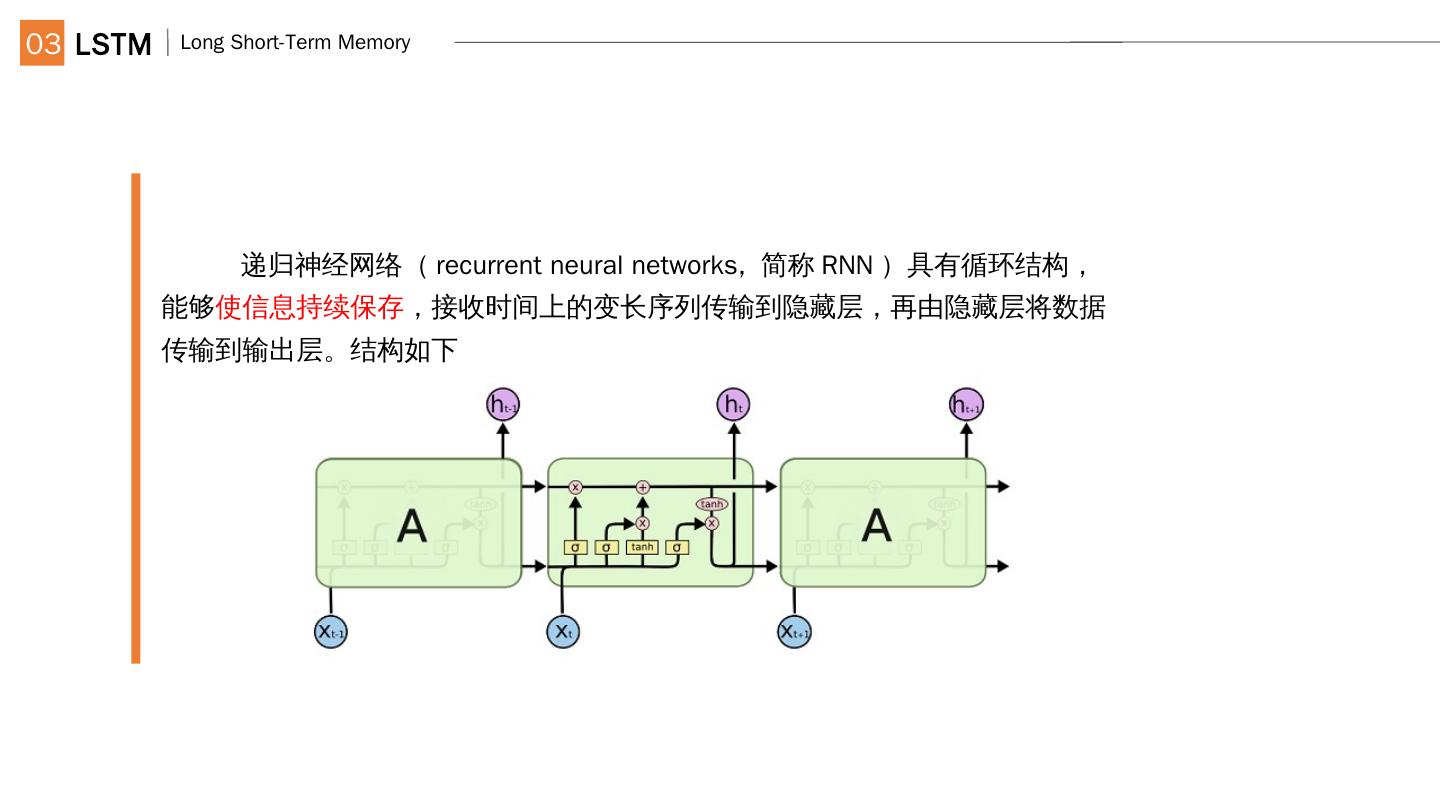

8 .02 递归神经网络 RNN

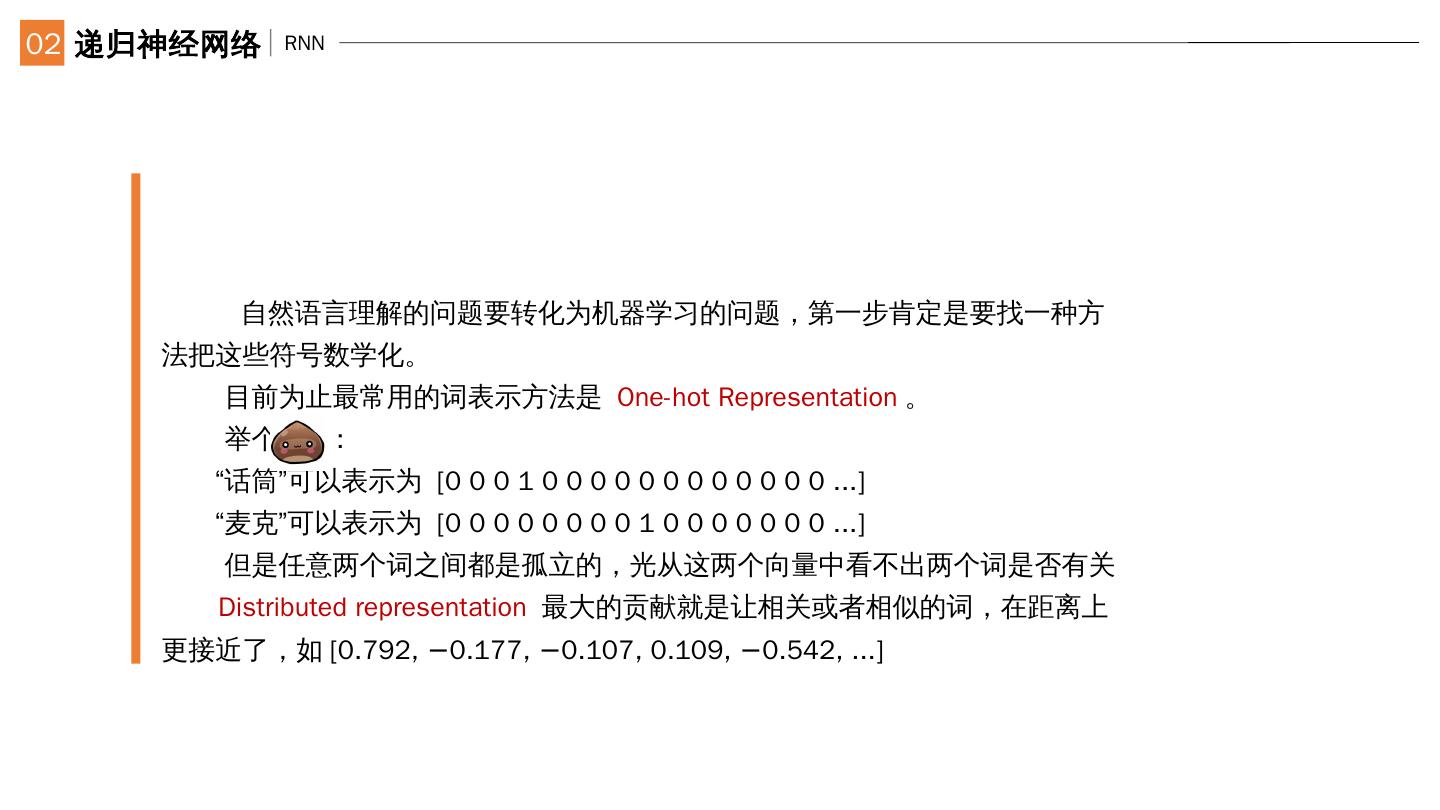

9 .递归神经网络 RNN 02 词向量 自然语言理解的问题要转化为机器学习的问题,第一步肯定是要找一种方法把这些符号数学化 。 目前为止最常用的词表示方法是 One-hot Representation 。 举个 : “话筒”可以表示为 [0 0 0 1 0 0 0 0 0 0 0 0 0 0 0 0 ...] “麦克”可以表示为 [0 0 0 0 0 0 0 0 1 0 0 0 0 0 0 0 ...] 但是任意两个词之间都是孤立的,光从这两个向量中看不出两个词是否有关 Distributed representation 最大的贡献就是让相关或者相似的词,在距离上更接近了,如[0.792, −0.177, −0.107, 0.109, −0.542, ...]

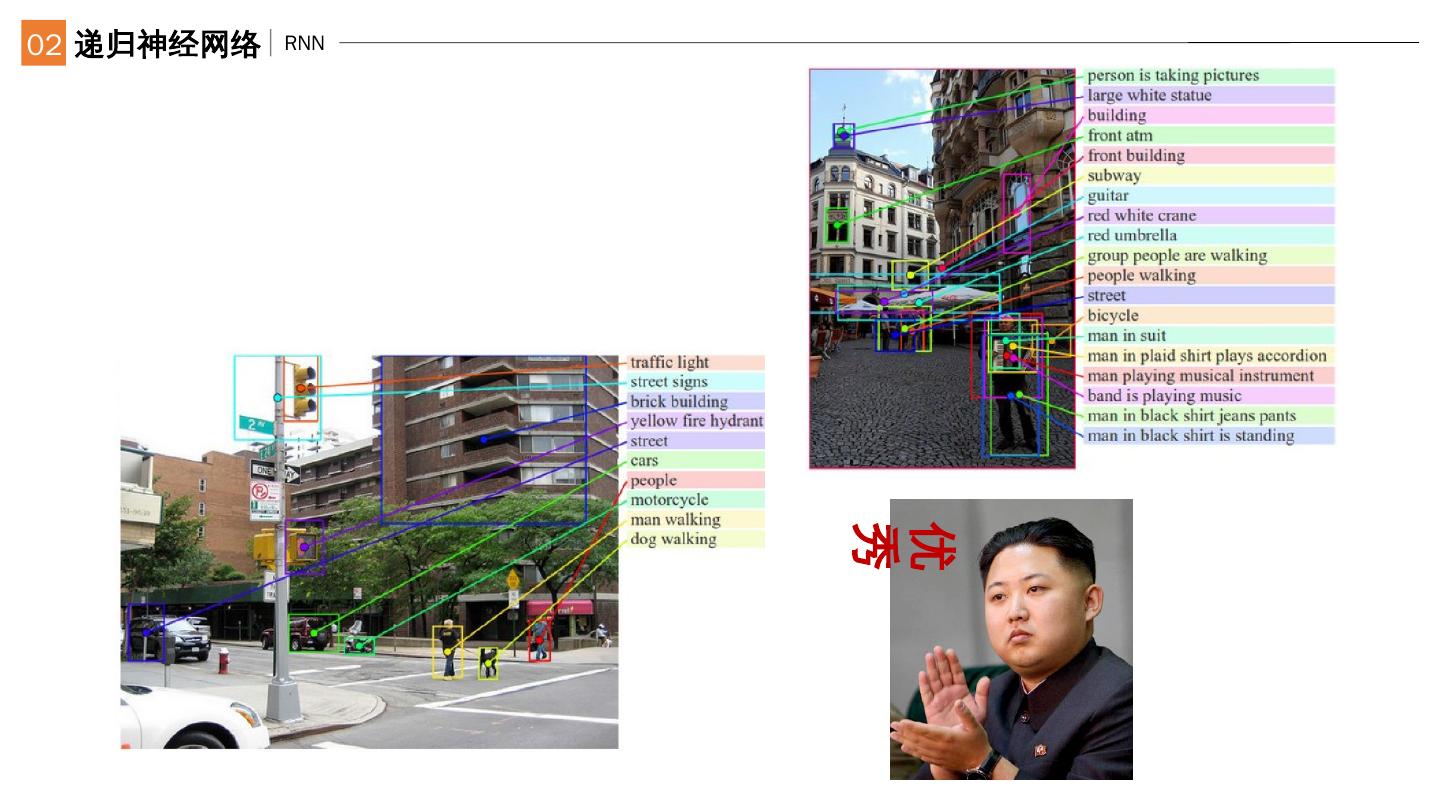

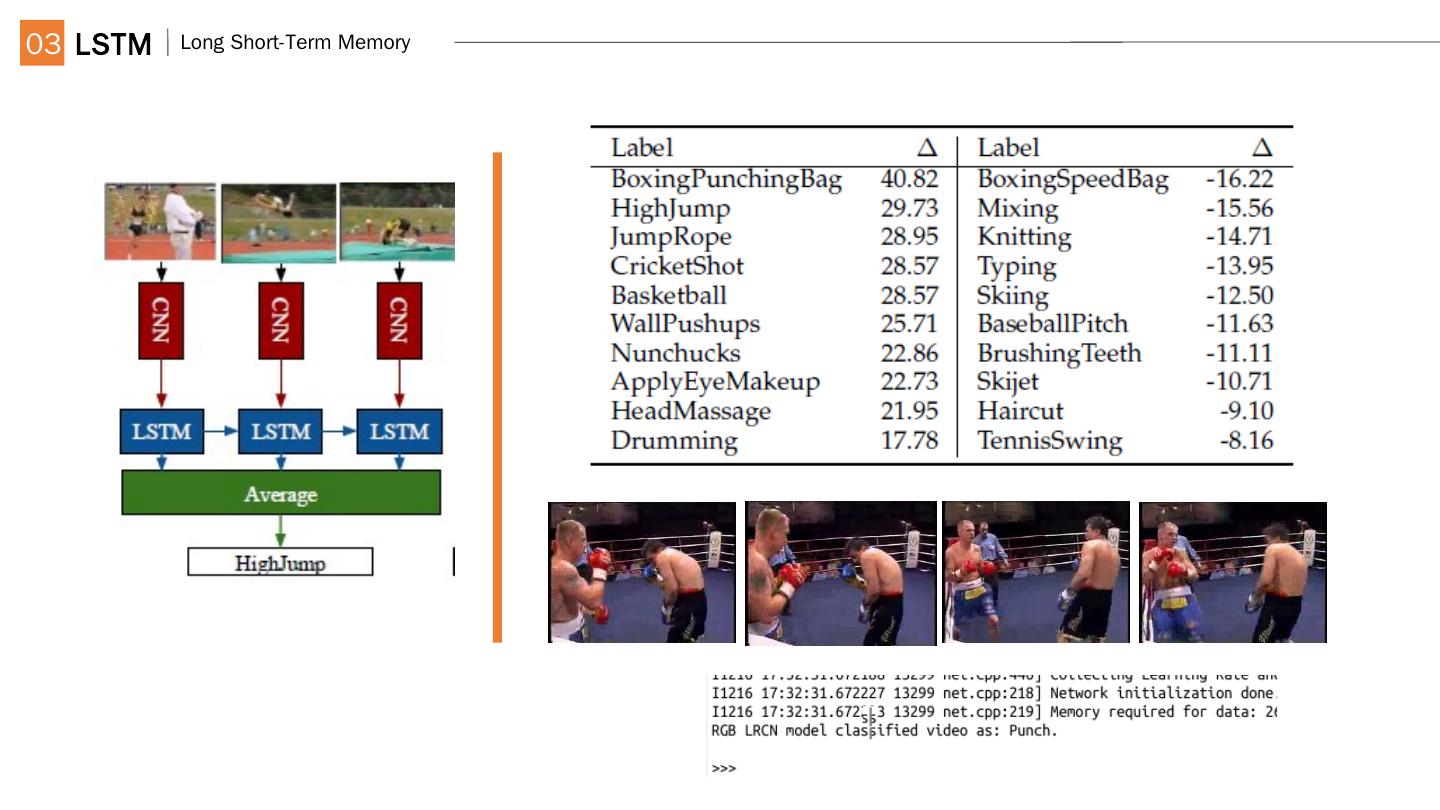

10 .02 递归神经网络 RNN 02 图 3 自然语言生成模型 他就是优秀的 RNN 李飞飞和他的图像描述

11 .表 1 实验结果 02 递归神经网络 RNN 02 这么优秀!

12 .02 递归神经网络 RNN 02 优秀

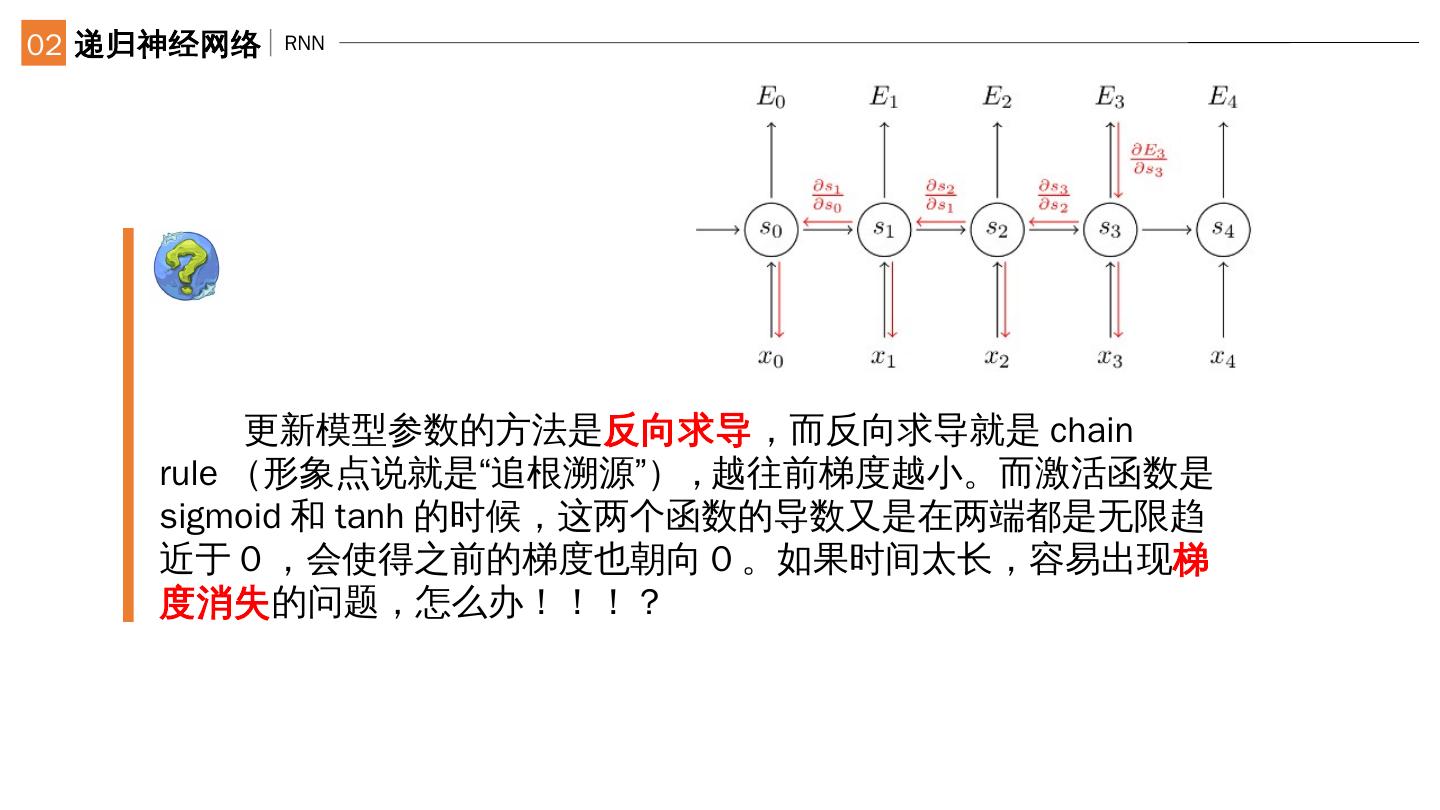

13 . 更新模型参数的方法是 反向求导 ,而反向求导就是chain rule(形象点说就是“追根溯源”) , 越往前梯度越小。而激活函数是sigmoid和tanh的时候,这两个函数的导数又是在两端都是无限趋近于0,会使得之前的梯度也朝向0。如果时间太长,容易出现 梯度消失 的问题,怎么办!!!? 02 递归神经网络 RNN 02 梯度消失

14 .03 LSTM Long Short-Term Memory

15 .LSTM Long Short-Term Memory 03 LSTM 递归神经网络(recurrent neural networks, 简称RNN)具有循环结构,能够 使信息持续保存 ,接收时间上的变长序列传输到隐藏层,再由隐藏层将数据传输到输出层。 结构如下

16 .LSTM Long Short-Term Memory 03 遗忘结构 决定哪些信息需要从单元状态中抛弃,为单元状态中的每个数字计算一个 0 和 1 。 更新结构 决定在单元状态中需要存储哪些新信息 。 首先决定 i t 哪些值需要更新 。 接下来 , 新候选值 可以添加到这个状态中 。 传递结构 更新旧单元状态了,输入到新单元状态 。因为只进行小的线性操作,所以信息以不变的方式向下流动。 输出结构 是时候该点输出什么了。 o t 决定了时刻 t 要输出哪些单元状态, h t 为时刻 t 的输出。

17 .02 递归神经网络 RNN 02 Jeff Donahue 和他的 LRCN

18 .LSTM Long Short-Term Memory 03

19 .LSTM Long Short-Term Memory 03 以 <BOS> 为开始标志,以 <EOS> 为结束标志

20 .LSTM Long Short-Term Memory 03 以 <BOS> 为开始标志,以 <EOS> 为结束标志

21 .LSTM Long Short-Term Memory 03 LSTM 目前在行业内有着 广泛的应用 ,范围包括但不限于:不分段连续手写识别上、自主语音识别、机器翻译等等。 02 01 LSTM可以记忆不定时间长度的数值,区块中有一个 Gate 能够决定input是否重要到能被记住及能不能被输出output。 03 2009年,用LSTM构建的人工神经网络模型赢得过 ICDAR手写识别比赛冠军 。LSTM还普遍用于自主语音识别,2013年运用 TIMIT 自然演讲数据库达成 17.7%错误率 的纪录。

22 .04 眼下 NOW

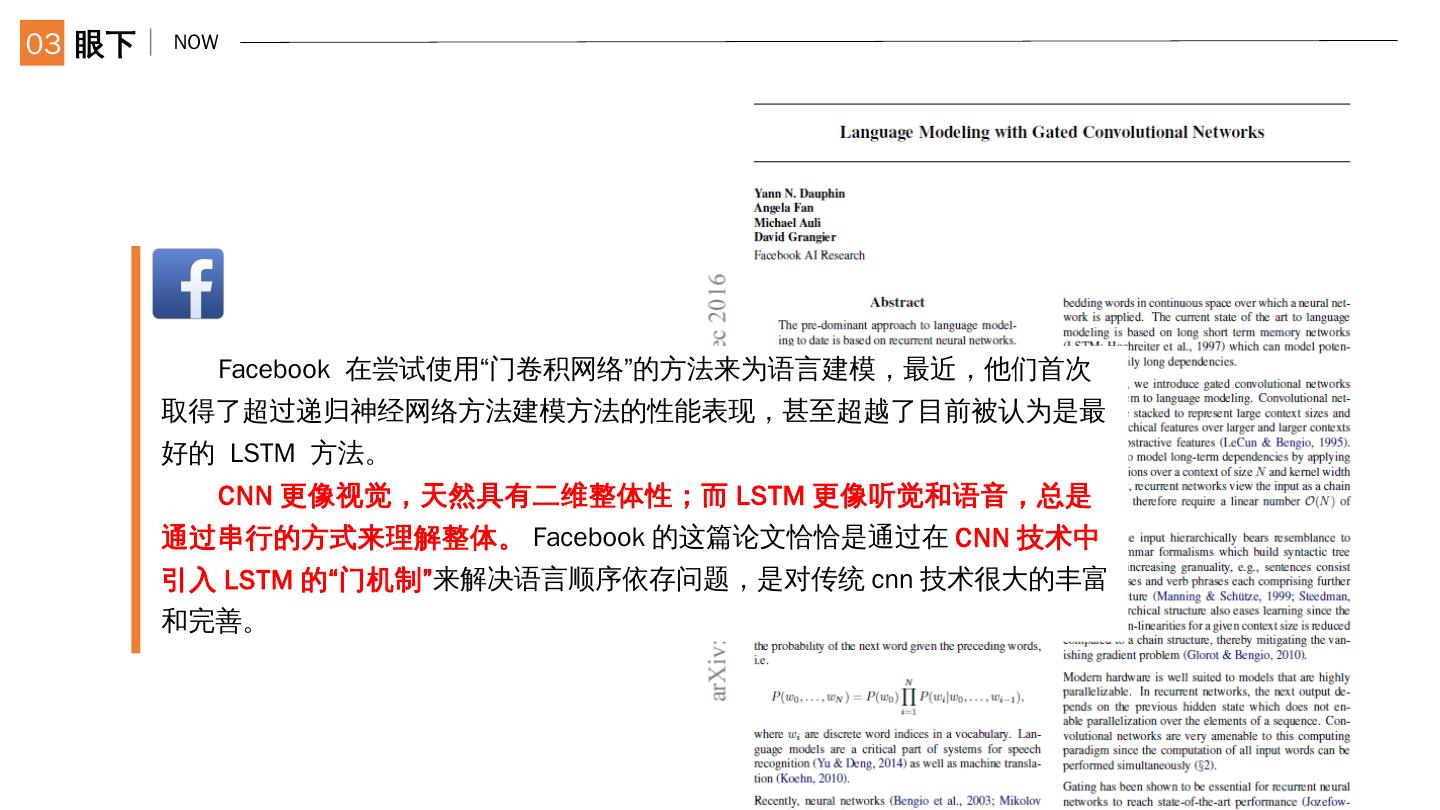

23 .眼下 NOW 03 Facebook 在尝试使用“门卷积网络”的方法来为语言建模,最近,他们首次取得了超过递归神经网络方法建模方法的性能表现, 甚至 超越 了 目前被认为是最好的 LSTM 方法。 CNN更像视觉,天然具有二维整体性;而LSTM更像听觉和语音,总是通过串行的方式来理解整体。 Facebook的这篇论文恰恰是通过在 CNN技术中引入LSTM的“门机制” 来解决语言顺序依存问题,是对传统cnn技术很大的丰富和完善 。

24 .03 门(gating)机制控制着神经网络中的信息流动 ,在1997年时就被 Schmidhuber等人证明在递归神经网络中非常有用。LSTM通过一个由输入控制的单独单元(cell)和forget gates来激活长期记忆,这能让信息在多个时间点可以无阻碍地流动。如果没有这些门的存在,信息在每一个时间点上的变化可能会导致消失的情况。相反地, 卷积神经网络并不会存在梯度消失的问题 ,在实验中,我们发现,他们并不要求有forget gates。 研究者基于谷歌 Billion Word(GBW)进行测试 ( <S> 开头 </S> 结尾) ,并与几个强大的 LSTM 和RNN 模型性能进行横向对比。得到的结果如下: 眼下 NOW

25 .谢谢 观看